De uns anos para cá um fenômeno deixou as mesas de especialistas para se tornar o foco das atenções do público em geral. Este fenômeno se chama “inteligência artificial”, este ente misterioso que transforma o frio computador digital em algo que parece humano.

Ela vem ocupando diversos espaços, até mesmo onde nem percebemos e já domina e controla muitos aspectos das nossas vidas sem que tenhamos noção disso, para o bem ou para o mal. Desde a qualidade da imagem da sua TV da sala a até a segurança de vôo de um avião de passageiros ou de carros autônomos, ou até mesmo a capacidade de lançamento de armas nucleares. E é justamente por isso que precisamos falar dela em aspectos geralmente pouco divulgados ou explorados para o grande público.

Arthur C. Clarke, autor de muitos clássicos de ficção científica, formulou algumas das suas “leis” sobre a ciência, e uma delas diz que “se uma tecnologia se torna tão avançada que se torna incompreensível para a maioria das pessoas, ela se parece com magia”.

Pois este é o caso da inteligência artificial (“I.A.”), que cada dia mais, cerca, até de forma invisível, nossas vidas.

Conversar com inteligência artificial como o ChatGPT ou o Gemini surpreende num primeiro instante, mas depois parece se tornar aquele amigo sempre disposto a elogiar e tirar nossas dúvidas, e até nos incentivar ou consolar se demonstrarmos que precisamos de apoio. Mas será que essas entidades que tanto nos parecem inteligentes realmente o são? O que elas são por dentro? Elas podem ser perigosas como em tantas obras da ficção científica?

Esta é a proposta desta série de artigos: mostrar exatamente o que está, em termos gerais, “debaixo do capô” desta tecnologia de uma forma acessível por parte do público leigo, pois há sim muitas maravilhas que esta tecnologia promete, porém há riscos claros em seu uso, mas que poucos estão falando e menos ainda de forma compreensível pelo grande público.

I – A balança, o raciocínio, a decisão e a ação

Vamos começar a entender alguns princípios elementares, mas nem por isso inocentes.

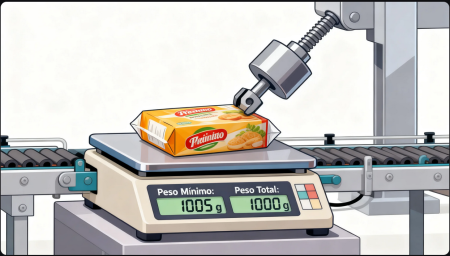

Imagine uma balança instalada logo após uma empacotadora de algum produto alimentício. Esta balança possui uma programação bastante simples: se o pacote que acabou de ser criado estiver abaixo de um peso mínimo, ele deve ser rejeitado e não deve seguir para venda, quando então ela pode acionar um pistão que remove o pacote indevidamente mais leve da esteira de transporte.

É uma automação bastante elementar, mas ela é composta de quatro etapas:

- Primeiro ela pesa o pacote;

- Em seguida, ela compara o peso do pacote com um valor mínimo;

- Então, ela decide que, caso o pacote esteja leve demais, ele deve ser rejeitado;

- Por fim, se a decisão dela for de rejeitar, então ela aciona o pistão que remove o pacote da esteira.

A pergunta que fica é: a balança é inteligente?

Esta é uma pergunta interessante. Certamente qualquer um dirá que ela não é inteligente, porém é inegável que ela age de forma inteligente, ao ponto que ela substituiu o ser humano que fazia seu trabalho antes desta automação.

Há uma antiga definição de software que resolve esta pergunta. Esta definição diz que o software é a síntese do pensamento do seu programador em forma de instruções lógicas para solucionar aquele problema, e que depois manifestará este pensamento independente da interferência deste programador. O modo de operação da balança reflete de forma sintética o pensamento original do programador, mesmo que agora ela se manifeste alheia à vontade dele a cada oportunidade.

Concluindo: a inteligência na ação da balança, de certa forma, existe, porém ela não pertence à máquina, mas é a manifestação da inteligência original do seu programador, ocorrida em algum ponto do passado.

Embora a máquina em si não seja inteligente, ela gera uma realidade impactante: ao agir, ela transforma o ambiente que a cerca, alterando a realidade das pessoas que a circundam.

Ela inicialmente tomou o lugar de um ser humano que antes realizava este trabalho, com larga vantagem. A máquina é muito mais produtiva e elimina praticamente todos os erros cometidos por humanos, não é desatenta, não fica doente, não tira férias, trabalha 24 horas por dia sem se cansar, não custa salário e encargos sociais… Embora a máquina tenha um custo elevado de aquisição e implantação, ela se paga com alta eficiência e alta produtividade.

Outro impacto na realidade das pessoas é que elas podem confiar que nunca comprarão aquele produto numa quantidade inferior à declarada.

Aqui ainda não é o lugar de se julgar se estas ações são éticas ou não. O importante é entender que a ação da máquina automática causa impacto na vida das pessoas, mesmo que distante e indireto, positivo ou negativo, e precisamos acender aqui uma luz de alerta, pois ela pode oferecer riscos tanto quanto vantagens, riscos estes que normalmente não se mencionam abertamente.

II – Cognição e semântica

Vamos imaginar que, numa prova de automobilismo, dois carros se toquem e causem um acidente. Os fiscais veem imagens do acidente de diversos ângulos para determinar se o toque foi ou não malicioso, ou se foi apenas um acidente de corrida.

A física pura, matemática e precisa, pode descrever perfeitamente as trajetórias e as energias associadas ao toque e ao acidente. É a parte que a programação do tipo que foi usada na balança do exemplo anterior consegue lidar perfeitamente. Esta programação, chamada de “booleana”, dá conta da maioria das situações que vemos computadores lidando. Ela é uma programação precisa e bastante confiável, mas ela não é flexível para ser capaz de interpretar os fatos humanos como a malícia da ação.

Os fiscais precisam ver em detalhes e interpretar o que aconteceu ali em aspectos que fogem da física para então concluir que houve ou não uma ação maliciosa por um dos pilotos.

O processo de raciocínio para a interpretação do acidente chama-se cognição, enquanto a conclusão, se foi ou não uma manobra maliciosa, é o que se chama de semântica. É a conclusão semântica que dá embasamento para o raciocínio cognitivo e recria o cenário físico e psicológico da ação do piloto.

Um dos grandes problemas de colocar um computador para lidar com situações humanas é que ele precisa de uma capacidade cognitiva (ou uma pseudo-capacidade, por algum mecanismo que a simule) para obter um resultado semântico.

Se desejarmos automatizar o processo de julgamento dos fiscais (sim, isto já foi feito), há uma série de camadas de interpretação cognitiva e conclusão semântica que o computador deve processar, a começar pelo conjunto de pixels que formam as imagens para determinar as trajetórias dos veículos e depois se esses movimentos são ou não maliciosos. E por fim o computador julga se a ação foi ou não maliciosa. Para evitar falhas de julgamentos, os juízes reavaliam o trabalho do computador para só então aplicar a punição proporcional.

III – O Princípio da Caixa Preta

Existe uma espécie de princípio na engenharia e em muitas outras áreas do conhecimento humano, sob diferentes formas e descrições, que podemos chamar de Princípio da Caixa Preta.

Este princípio diz que um sistema pode ser tratado como uma espécie de “caixa preta”, da qual desconhecemos seu príncípio de funcionamento, embora possamos observar as entradas (“inputs”), bem como as saídas (“outputs”) que são produzidas a partir das entradas pelo mecanismo interno desconhecido da caixa preta.

Então o Princípio da Caixa Preta dá um passo adiante, ao propor que, se uma caixa preta for substituída por outra, usando as mesmas entradas e, a partir delas, reproduzir precisamente as mesmas saídas, então estas duas caixas pretas são equivalentes, não importando quão diferentes sejam entre si.

Um exemplo simples de substituição de caixa preta foi a troca dos relógios analógicos puramente mecânicos por relógios analógicos com acionamento eletrônico, com base de tempo por cristal de quartzo (geralmente mostrado como “QUARTZ” no mostrador). A entrada destes relógios é a observação do mostrador, enquanto a saída é a mera interepretação da hora pela posição dos ponteiros. Neste aspecto, a substituição de uma “caixa preta” pela outra é totalmente equivalente, e nem em uma como em outra, o usuário precisa saber como os dois tipos de relógios funcionam para usufruir da funcionalidade que eles oferecem.

Mas é justamente aqui que essa substituição começa a mostrar que ela não é plenamente equivalente, e isso trás vantagens e desvantagens.

O relógio mecânico exige que o usuário constantemente “dê corda”, enquanto o relógio eletrônico usa uma bateria de longa duração. Se por um lado o usuário do relógio eletrônico não precisa estar alimentando o seu relógio (“dando corda”) como o usuário do relógio mecânico, por outro lado, quando a bateria se esgota, ele precisa substituir essa bateria, que muitas vezes não está imediatamente disponível e pode exigir o serviço de um relojoeiro especializado.

A história da humanidade está cheia de substituições de tecnologias como se fossem caixas pretas, que, embora sirvam como trocas inicialmente equivalentes, demonstraram que as diferenças justamente nas nas entradas e saídas não exatamente equivalentes é que tornam essas substituições cheias de vantagens e desvantagens, e que nunca são totalmente equivalentes.

Muitas tecnologias entram e saem das nossas vidas inicialmente como uma substituição tipo “caixa preta”, para então evoluírem e se transformarem. Algumas destas tecnologias tecnologias podem até mesmo coexistir por anos a fio ao invés de uma mais nova substituir completamente sua predecessora.

Foi assim a substituição dos barcos a vela pelo vapor e depois pelos motores a combustão, da válvula termoiônica pelo transístor, do platinado e carburador pela injeção eletrônica, e assim por diante.

IV – A Caixa Preta de Turing

Alan Turing, o gênio que ajudou os ingleses a derrotar os alemães na 2ª Guerra Mundial, encurtando o conflito por pelo menos 2 anos e salvando muitas vidas dos dois lados, e pai da moderna computação, era obcecado com a ideia de que máquinas poderiam pensar.

Em seu famoso artigo de 1950, Computing Machinery and Intelligence, ele substituiu a pergunta “As máquinas podem pensar?” pelo Jogo da Imitação (hoje conhecido como Teste de Turing).

Pilares do Princípio de Turing:

- Critério de Indistinguibilidade: Uma máquina é considerada inteligente se um avaliador humano, ao interagir com ela e com outro humano via texto, não conseguir distinguir qual é qual com segurança.

- Comportamento sobre Consciência: Turing argumentou que não precisamos provar que a máquina “sente” ou “tem alma”. Se ela age de forma inteligente, ela deve ser tratada como tal.

- A “Mente de Criança”: Ele sugeriu que, em vez de tentar programar todo o conhecimento de um adulto, seria mais eficaz criar um programa que simulasse o cérebro de uma criança e submetê-lo a um processo de educação (aprendizado), antecipando o conceito moderno de Machine Learning.

- Universalidade Computacional: Baseado em sua própria Máquina de Turing, ele defendia que computadores digitais são “máquinas de estado discreto” capazes de imitar qualquer processo lógico humano, desde que tivessem memória e regras suficientes.

Sob a ótica do Princípio da Caixa Preta, é evidente que Turing realmente não definiu se uma máquina é realmente capaz de pensar, mas seu princípio, chamado de “Jogo da Imitação” é, em todos os aspectos, a substituição de uma caixa preta por outra, na qual testamos sua equivalência.

V – O Quarto Chinês

Durante muitos anos, muitos especialistas consideravam o Teste de Turing como uma forma de provar que uma máquina seria capaz de pensar.

Para Turing, se a máquina “se parece inteligente, então ela é inteligente”.

Inconformado com esta visão mecanicista da inteligência, o filósofo John Searle criou em 1980, um teste conceitual para refutar a idéia de Turing, sendo a crítica mais forte a este modelo. A ideia por trás do teste que Searle propôs é a de que “simular a compreensão não é o mesmo que compreender”.

O experimento mental proposto por Searle parte da seguinte ideia:

- O algoritmo: Um homem, que não fala chinês, trancado em um quarto segue as instruções de um gigantesco livro de instruções;

- A entrada: Uma pessoa do lado de fora tenta conversar com o homem dentro do quarto passando papéis escritos em ideogramas chineses;

- O processamento: O homem dentro do quarto observa o ideograma do papel e segue as instruções do livro, tipo “se o símbolo for ‘X’, escreva o símbolo ‘Y’”;

- A saída: A resposta é então passada de dentro para fora do quarto por baixo da porta, em chinês perfeito.

Para o homem do lado de fora do quarto, a impressão é que há um interlocutor fluente em chinês dentro do quarto, passando no Teste de Turing, quando na verdade o que existe é um mecanismo que simula a fluência em chinês, e o homem lá dentro não tem a mínima ideia do que está fazendo

As principais conclusões de Searle:

- Sintaxe vs. Semântica: Computadores são ótimos em manipular símbolos (sintaxe), mas isso não lhes dá acesso ao significado real das coisas (semântica).

- IA Forte vs. IA Fraca: Searle aceita que máquinas podem simular o pensamento para resolver problemas (IA Fraca), mas nega que elas possam ter mentes ou consciência reais (IA Forte).

- Biologia da Mente: Para ele, a consciência é um fenômeno biológico (como a digestão ou a fotossíntese) que não pode ser replicado apenas com código de computador.

Apesar da lógica de Searle, muitos cientistas da computação criticam o argumento, afirmando que, embora o homem não entenda chinês, o sistema como um todo (homem + manual + quarto) possui o entendimento. E a polêmica segue.

VI – A inferência vesus a inteligência

Uma I.A., vista por dentro, é, ao seu próprio modo, uma máquina de inferência, ou mais popularmente, uma máquina de estimativa.

Um processo de inferência é algo como “um salto bastante calculado no escuro”, tentando extrapolar respostas sobre o que ainda não se conhece ou que ainda não aconteceu, dado a partir de uma base de conhecimento sobre o objeto que se deseja inferir.

Embora a natureza do algoritmo da I.A. seja muito diversa dos princípios matemáticos da estatística, ela é, em muitos aspectos, muito semelhante.

Num processo de inferência estatística, o processo leva em consideração alguns componentes:

- A população: O conjunto total de elementos que queremos estudar;

- A amostra: Um subconjunto representativo da população;

- Parâmetros: São os valores reais da população;

- Estatísticas: são valores calculados a partir da amostra,.

A estes componentes são aplicadas as principais ferramentas:

- Estimativa de Ponto: Um valor único (exemplo: a média da amostra) usado para estimar o parâmetro popúlacional;

- Intervalos de Confiança: Em torno deste ponto, define-se uma faixa de valores dentro de um intervalo de confiança, tipo “a média é de 100, mas o parâmetro da população situa-se na faixa de 98 a 102 com 95% de confiança”.

- Testes de Hipóteses: São métodos para verificar se uma suposição sobre a população, feita a partir dos dados obtidos da amostra, é estatisticamente provável ou se a diferença observada é apenas fruto do acaso.

É a partir destes métodos matemáticos bastante precisos que uma inferência estatística (ou um “chute com critério”, se assim preferirem) pode ser feita, gerando uma extrapolação rumo a um desconhecido, mas cuja projeção é bastante provável.

A inteligência artificial possui mecanismos muito semelhantes internamente, observando os dados de entrada, comparando-os com padrões aprendidos e fazendo suas próprias inferências.

Até mesmo o tão famoso “aprendizado de máquina” é uma forma de amostragem dos dados que cria a estrutura dos padrões com que as entradas serão comparadas para geração das saídas da I.A..

Por fim, uma conclusão importante: ao seu próprio modo, a I.A. é um grande método estatístico, baseado no aprendizado sobre amostras. Sendo um método estatístico, ele se contrapõe totalmente ao método booleano dos computadores tradicionais, que são altamente precisos. A I.A., por sua própria natureza, é intrinsecamente imprecisa e, por isso mesmo, oferece riscos em suas respostas.

As chamadas “alucinações” da I.A. são inferências que possuem bases sólidas sobre o mecanismo de previsibilidade, mas que podem ser completamente díspares do mundo real observável.

Voltando ao exemplo da balança, observamos que as máquinas automatizadas tomam decisões sobre o mundo real, e por isso, transformam este mundo em volta delas. Uma I.A. pode alucinar, tomar decisões e agir de modo inapropriado, causando grandes prejuízos ao mundo em que vivemos.

Evidentemente, a I.A. é uma ferramenta tecnológica poderosíssima e sem par no mundo moderno, mas ela oferece riscos significativos que nem sempre são divulgados com a importância devida.

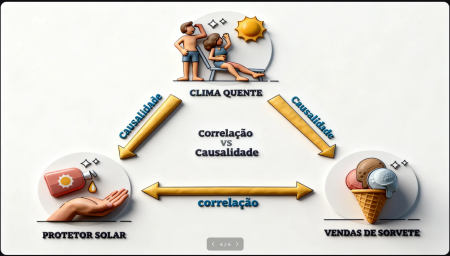

VII – O Olhar Matemático: Padrões, Correlações x Causas

Um dos maiores trunfos – e de riscos – da I.A. reside na sua capacidade sobre-humana de reconhecimento de padrões. Ela consegue varrer bilhões de dados e encontrar correlações sutis — conexões entre variáveis que jamais foram percebidas por olhos humanos ou estatística tradicional. É como um engenheiro de pista que, ao olhar para gigabytes de telemetria, percebe uma vibração específica que antecede uma quebra, algo que ninguém havia notado antes.

No entanto, aqui mora um perigo conceitual: a I.A. é mestre em correlação, mas cega para a causalidade.

- A Correlação (O que a I.A. vê): Ela nota que ‘sempre que o evento A acontece, o evento B também ocorre’.

- A Causalidade (O que a I.A. ignora): Ela não entende por que A causa B. Ela não conhece as leis da física, da termodinâmica ou do comportamento humano que ligam os dois fatos.

Esta incapacidade de lidar com causalidades é das principais fontes de alucinações da I.A., pois, para a máquina, alta correlação entre eventos é um padrão sólido para uma inferência, mas a incapacidade de perceber relação de causa e efeito entre dois fenômenos pode levá-la a inferências absurdas.

A análise das vantagens e principalmente dos riscos que fará parte da próxima parte deste artigo.

AAD