Vimos na primeira parte destes artigos um conjunto de elementos filosóficos e funcionais que estão na raiz da I.A.. Eles são fundamentais para entendermos os contextos passados, presentes e futuros desta tecnologia, bem como de suas aplicações. Mas há ainda mais alguns conceitos que precisam ser explorados.

I – A minha trajetória pessoal no mundo da I.A..

Fui um dos primeiros engenheiros mecatrônicos formados no país, mais especificamente, da segunda turma formada. Naquela época, o perfil da mecatrônica era bem diferente do atual. Na minha época houve muito espaço para discussões filosóficas e técnicas, enquanto os perfis de mecatrônica atual são mais práticos e de aplicação imediata. Porém, é justamente esta formação mais filosófica que está no cerne de muitas das modernas discussões sobre a I.A., porque esta discussão é praticamente atemporal. E esta série de artigos carrega exatamente este espírito, junto com uma experiência profissional que acompanhou esta evolução por mais de 30 anos.

II – Ambientes controlados e não controlados

Naquela época, havia muita discussão sobre a I.A. e mais amplamente a automação como um todo. Era a distinção entre ambientes controlados e ambientes não controlados como um indicativo sobre a facilidade de se automatizar qualquer tipo de processo.

Um exemplo de ambiente controlado é uma máquina de usinagem CNC (Comando Numérico Computadorizado). Era uma máquina considerada ambiente controlado, pois não eram esperadas grandes interferências aleatórias, e mesmo os problemas que poderiam ocorrer eram perfeitamente previsíveis e controláveis quando ocorriam. Era justamente a facilidade do ambiente controlado que permitia que uma tecnologia não tão flexível quanto a lógica booleana poderia comandar a máquina com total eficiência.

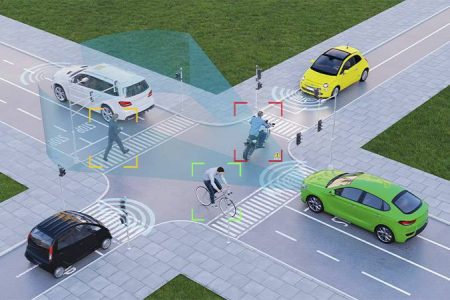

Já um carro autônomo lida com um ambiente não controlado. Há todo tipo de interferências que ocorrem em torno do carro enquanto ele se desloca: sinais de trânsito estáticos e variáveis (como placas e semáforos), carros que podem frear bruscamente à frente, pedestres que tentam atravessar inesperadamente na frente do carro, etc..

É clássico o exemplo que é dado em autoescolas de que atrás de uma bola que cruza uma via sempre vem uma criança atrás. Para motoristas humanos, isso é até elementar de se falar, mas para uma máquina é impossível de tratar com a rígida lógica booleana. Para estes tipos de casos, exige-se um tipo de raciocínio altamente cognitivo.

Trinta anos atrás, falar em um robô autônomo se movendo e atuando com total sucesso num ambiente não controlado era uma mera ficção, ainda muito distante da realidade técnica.

Mas então, em 2004, me chega a notícia do DARPA Gran Challenge, uma competição promovida pelo DARPA americano para carros autônomos. A notícia me chegou antes da competição propriamente dita e, entre 15 equipes inscritas, a favorita para esta competição era a RedTeam da universidade Carnegie Mellon e seu veículo Sandstorm, um Hummer militar convertido para direção autônoma. Seria uma competição onde os carros teriam de seguir uma rota pré-determinada pelo deserto de Mojave, num percurso de 240 km.

Esta competição foi bastante discutida pela mídia da época.

Entretanto, no dia da competição, dia 13 de março de 2004, todos os participantes falharam a poucos quilômetros da largada, sendo que o Sandstorm capotou numa curva a 11,9 km da largada, sendo o veículo que percorreu a maior distância, menos de 5% do trajeto previsto para a prova.

O resultado parecia desanimador, mas em nova edição do evento em 2005, o Sandstorm se tornou o vencedor, demonstrando o quanto a tecnologia havia evoluído, e mostrando que ambientes não controlados começavam a ser desafiados pelas novas gerações de máquinas, o que era apenas um sonho 15 anos antes.

O que mudou nesses 15 anos não foi apenas a capacidade de processamento dos computadores. Foi principalmente a mudança de paradigma na forma de programar máquinas. Enquanto os algoritmos tradicionais da computação são essencialmente booleanos e determinísticos, o aprendizado de máquina introduz uma lógica completamente diferente: uma lógica estatística e probabilística, baseada na observação de grandes volumes de dados.

III – Os diferentes tipos de I.A.

Quando a maioria das pessoas ouve falar em I.A. imediatamente elas pensam em uma tecnologia recente, mas elas não poderiam estar mais enganadas.

Em primeiro lugar, as primeiras técnicas de I.A. remontam à década de 1950, e estas técnicas se somam às centenas.

O comportamento das formigas, por exemplo, oferece uma solução elegante ao problema do caixeiro viajante, que é um problema típico de otimização de rotas para a logística de veículos de entregas.

Há também diversas outras lógicas baseadas em comportamentos da natureza que geram soluções inteligentes, como comportamentos de enxames, como de abelhas, revoadas de pássaros e cardumes de peixes. Existe até uma ciência focada neste tipo de estudo, chamada de mimética, que busca imitar soluções da natureza como elementos de engenharia.

Existem também algoritmos genéticos, que misturam a ideia da genética como construtora de instruções com um sistema de seleção darwiniano, em total paralelo com a teoria da evolução das espécies de Charles Darwin. Uma observação interessante é que algoritmos genéticos demonstram, na prática computacional, como mecanismos inspirados na evolução podem produzir soluções altamente eficientes.

IV – As redes neurais

Porém, o tipo de I.A. mais amplamente conhecido atualmente, e o tipo mais desenvolvido, é o das chamadas redes neurais.

Estas redes possuem como elemento básico uma emulação simplificada de um neurônio animal, tecnicamente conhecido como perceptron.

O perceptron é, essencialmente, um modelo matemático simplificado de um neurônio biológico, capaz de tomar decisões simples a partir de múltiplas entradas ponderadas.

O conceito matemático de neurônio artificial surgiu em 1943 com Warren McCulloch e Walter Pitts. O perceptron propriamente dito foi desenvolvido em 1957 por Frank Rosenblatt. É, portanto, uma ideia já bem antiga.

Apesar das supostas similaridades simplificadas com relação ao cérebro humano, a grande diferença entre nós e a máquina é que a inteligência artificial moderna não foi programada para saber.

Em vez de estabelecermos regras rígidas às máquinas, passamos a ensinar exemplos. Assim, ela foi treinada para reconhecer padrões, no que é sua excelência como ferramenta.

O perceptron funciona como uma caixa preta: possui um conjunto de entradas, internamente ele realiza uma operação matemática sobre estas entradas, e fornece uma saída.

Conectando milhares ou milhões de perceptrons em camadas sucessivas é possível construir sistemas capazes de reconhecer padrões extremamente complexos.

O conhecimento não está programado explicitamente. Ele está distribuído nas conexões entre os perceptrons.

Nas redes neurais, o processo de aprendizado nada mais é que estabelecer este conhecimento distribuído entre os perceptrons através de técnicas que, essencialmente são de tentativa e erro, apresentando uma entrada e conferindo se a saída está de acordo com o esperado.

V – Os “invernos” da I.A.

Quem tem acompanhado as notícias referentes à tecnologia I.A. deve ter ouvido falar de especialistas, em especial os ligados à chamadas big techs americanas, que o desenvolvimento de uma I.A. generativa, auto-consciente, está a apenas alguns anos de distância no futuro, gerando expectativas e grandes investimentos nessa tecnologia. Porém, muitos especialistas já começam a duvidar destas afirmações ufanistas, acreditando mesmo no “estouro da bolha” da I.A..

Como numa frase atribuída a Emerson M. Pugh:

– “If the human brain were so simple that we could understand it, we would be so simple that we couldn’t.”

– “Se o cérebro humano fosse tão simples que pudéssemos compreendê-lo, seríamos tão simples que não poderíamos.”

Numa interpretação mais compreensível desta frase, poderíamos dizer:

– “Se a mente humana fosse simples o suficiente para ser compreendida, seríamos simples demais para compreendê-la.”

Este pensamento sintetiza um fenômeno conhecido apenas nos círculos mais próximos da essência das tecnologias de I.A.: nosso cérebro não é tão simples para ser completamente imitado, e isto tem causado sucessivos ciclos de otimismo, euforia, desânimo, e abandono do desenvolvimento das técnicas de I.A.. E não foram poucos.

As fases piores no desenvolvimento destas tecnologias são conhecidas como “invernos”.

Quando estudava engenharia mecatrônica, a tecnologia de redes neurais enfrentava um “inverno” que persistiu por mais de 20 anos, presa a uma limitação técnica que apenas anos depois foi contornada para evoluir para a condição atual.

Mas o ufanismo exagerado e o volume gigantesco de investimentos podem acabar gerando frustrações, o que poderia desencadear um novo “inverno” da inteligência artificial.

VI – I.A. Forte e as I.A.s Fracas:

A I.A. generalista e autoconsciente, promovida aos 4 ventos pelas “big techs” é uma inteligência que permitirá que um robô jogue xadrez, participe de um jogo de futebol, discuta com um filósofo sobre as ideias de Platão e saiba girar a maçaneta para abrir a porta para passar por ela. É uma inteligência com a dimensão da mente humana.

Este tipo de inteligência é chamado de “I.A. Forte”.

A I.A. Forte prima pela capacidade de raciocínio geral, compreensão semântica dos fatos e situações, aprendizado transferível, e adaptação a novos contextos.

Há, no entanto, todo um conjunto de I.A.s que são focadas em apenas realizar uma função específica. Estas I.A.s são conhecidas como “I.A.s Fracas”, sendo altamente especializadas em resolver apenas um problema específico.

ChatGPT aparenta possuir uma inteligência humana quando conversamos com ele. Porém ele não foi projetado para jogar xadrez ou resolver problemas matemáticos complexos. Seu funcionamento consiste essencialmente em prever qual sequência de palavras tem maior probabilidade de formar uma resposta coerente.

Portanto, o ChatGPT é uma I.A. Fraca. Na verdade, até hoje, todas as inteligências artificiais existentes pertencem à categoria de I.A. fraca, por mais impressionantes que sejam seus resultados.

Mas é justamente aqui que o ramo das I.A.s têm brilhado, ao oferecer soluções além da capacidade humana, demonstrando a importância cada vez maior que esta tecnologia possui no nosso futuro.

Um exemplo recente ilustra bem esse tipo de capacidade ampliada da inteligência artificial.

Existe um conceito antigo de motor foguete dentro da área aeroespacial, chamado “aerospike”. Ao invés de um bocal em formato de sino como escape dos motores foguete que estamos acostumados, o aerospike possui um bocal em formato cônico. Ele tem a vantagem de oferecer o mesmo rendimento a qualquer altitude, diferente do bocal de formato de sino.

É uma solução elegante do ponto de vista físico, mas extremamente difícil de otimizar por métodos tradicionais de engenharia.

É aqui onde entra a I.A. Fraca.

O motor tem funcionamento simples, mas grande complexidade geométrica. A Universidade de Sheffield em parceria com a startup LEAP71, utilizando técnicas modernas de otimização assistidas por aprendizado de máquina num sistema de I.A. chamado Noyron, passou a explorar milhões de variações possíveis de design geométrico.

O resultado foi um design surpreendente: um conjunto de canais internos extremamente complexos, cuja geometria dificilmente seria concebida por raciocínio humano direto. O princípio físico continua simples. O que mudou foi a forma como a inteligência artificial explorou o espaço de soluções possíveis.

Aqui aprendemos um fator relevante sobre essas I.A.s altamente especializadas: elas podem oferecer soluções práticas, aplicáveis, mas cuja complexidade pode estar acima da capacidade de compreensão do ser humano.

Assim como este exemplo. I.A.s altamente especializadas estão descobrindo estruturas moleculares que poderiam demorar décadas para serem descobertas, novas formulações de antibióticos potentes e com baixos efeitos colaterais, estudar 40 anos de publicações científicas da área de medicina e ali fazer mais descobertas escondidas entre aqueles dados que nenhum ser humano percebeu.

O valor desta tecnologia para o futuro da humanidade é incalculável.

VII – I.A.s Fracas encadeadas

Existem soluções complexas que são impossíveis de serem atendidas por uma única I.A. Fraca. Um exemplo disso é a I.A. que controla um carro autônomo.

I.A.s podem ser encadeadas como uma árvore hierárquica, onde cada módulo de I.A. trata um aspecto específico da tarefa. Problemas grandes e complexos podem ser resolvidos com mais eficiência quando são decompostos em partes menores e mais simples, e muitas vezes tratadas em paralelo.

No caso do carro autônomo, exemplos de tarefas específicas a serem tratadas por módulos individuais de I.A. podem incluir:

- um sistema identifica faixas da pistaoutro detecta pedestres

- outro identifica sinais de trânsito[

- outro calcula trajetórias possíveis

- outro avalia riscos de colisão

Cada um desses módulos utiliza técnicas diferentes de inteligência artificial e produz resultados que são integrados por um sistema de decisão.

A tecnologia de carros autônomos ainda não está completa, apesar de já haver carros autônomos trafegando pelas ruas em diversos países, mas em caráter experimental.

É exatamente neste ponto que o problema começa a lembrar um velho conhecido da engenharia e da economia: o princípio de Pareto.

Provavelmente a tecnologia atual já cubra 90% das situações que um carro autônomo possa enfrentar nas ruas, porém são justamente os 10% faltantes que oferecem o maior desafio a atingir um carro autônomo 100% operacional.

O ambiente com que os carros autônomos trafegam são extremamente não controlados, fazendo-os enfrentar:

- pedestres imprevisíveis

- obras na via

- sinalização confusa

- clima adverso

- comportamento errático de outros motoristas

Mas os casos mais difíceis atualmente são:

- obras improvisadas

- acidentes na pista

- policiais controlando o trânsito

- comportamento humano imprevisível

- falhas de sinalização

Em engenharia, esses são chamados de casos de borda (edge cases).

Mesmo assim, sistemas modernos já atingiram um grau impressionante de desempenho.

Empresas como Waymo, por exemplo, já acumularam dezenas de milhões de quilômetros rodados com veículos totalmente autônomos em vias públicas. Estudos indicam que esses veículos apresentam reduções de cerca de 80% nos acidentes com feridos e mais de 90% nas lesões de pedestres, quando comparados com motoristas humanos em condições semelhantes.

Ainda assim, a autonomia completa ainda não foi plenamente atingida.

Projeções do setor indicam que até 2030 cerca de 90% dos carros novos terão algum grau de automação, embora apenas uma pequena fração atinja autonomia realmente elevada.

VIII – Uma revolução no método de engenharia.

A vida no planeta evoluiu ao enfrentar ambientes não controlados e desafiadores. Enquanto a genética determinava a forma, mas as formas existem em função da eficiência funcional.

Não há uma engenharia de projeto para dizer como cada parte de um ser vivo deve ser, mas as formas existem em função de uma funcionalidade realmente eficiente.

Durante séculos, a engenharia consistiu em projetar algo para que funcionasse. Com a inteligência artificial, começamos a encontrar coisas que funcionam antes mesmo de compreendermos completamente como projetá-las.

Talvez estejamos entrando numa era em que a engenharia deixa de ser apenas a arte de projetar máquinas e passa também a ser a arte de descobrir máquinas.

Isto representa uma das maiores mudanças metodológicas da história da engenharia.

IX– Conclusões da 2ª Parte:

Em poucas décadas, a inteligência artificial passou de um campo acadêmico especulativo para uma das tecnologias mais influentes da história moderna. Em muitas tarefas específicas ela já ultrapassou o desempenho humano, resolvendo problemas que durante décadas foram considerados intratáveis.

A inteligência artificial não substitui necessariamente o engenheiro ou o cientista, mas funciona como uma poderosa ferramenta de ampliação da capacidade humana de análise.

E é justamente por isso que esta é uma tecnologia sobre a qual grande parte do futuro será construída.

Talvez o impacto mais imediato dessa nova fase da inteligência artificial não esteja apenas nos carros autônomos ou nos motores projetados por algoritmos.

Ele começa a aparecer em algo muito mais próximo de todos nós: o trabalho humano.

AAD